Cuando diseñás una obra hidráulica —un vertedero, un puente, un sistema de drenaje urbano— necesitás saber con qué caudal dimensionarla. Ese caudal no se elige al azar: se asocia a una probabilidad de ocurrencia, o equivalentemente, a un período de retorno o recurrencia.

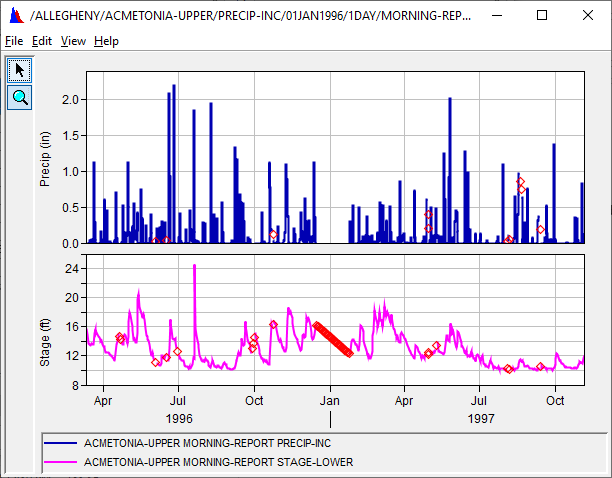

Pero ¿de dónde sale ese número y cómo se trabaja con el? Cuando disponés de registros de aforo en el cauce de interés, el camino es el análisis de frecuencias: ajustás una distribución estadística a los máximos anuales históricos y extrapolás para obtener el caudal correspondiente al período de retorno de diseño.

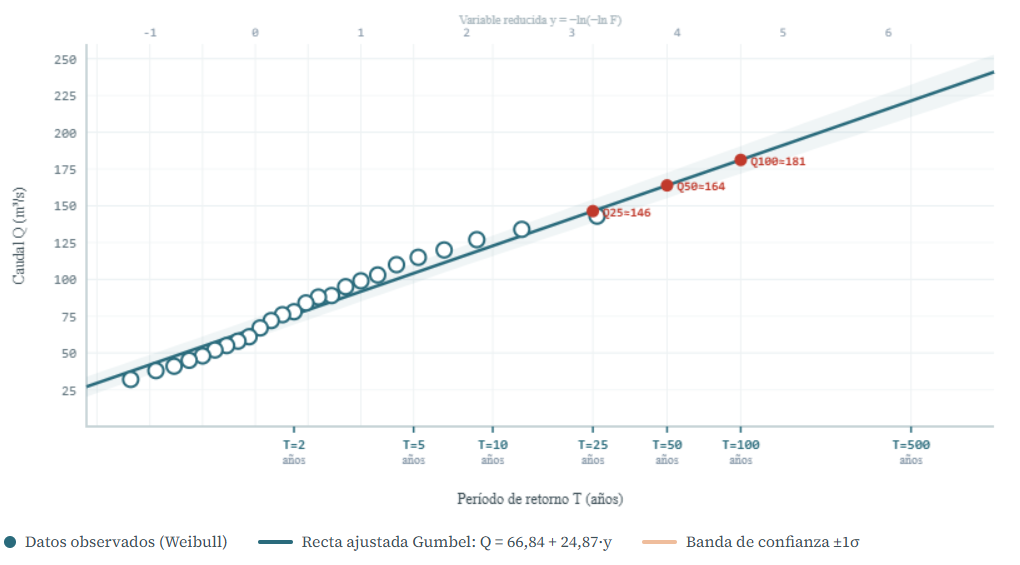

En esta entrada vamos a recorrer todo el proceso, desde los conceptos básicos hasta la construcción del gráfico de papel de probabilidad, con un ejemplo numérico completo ajustando la distribución de Gumbel a una serie de 25 años.

1. ¿Qué es el análisis de frecuencias y cuándo se aplica?

En hidrología, el análisis de frecuencias es el conjunto de técnicas estadísticas que permite estimar la magnitud de un evento —caudal, lluvia, nivel— asociada a una probabilidad de excedencia determinada.

A diferencia de los métodos indirectos como el Racional o el CN, que estiman caudales a partir de parámetros de la cuenca y la lluvia de diseño, el análisis de frecuencias trabaja directamente con datos observados en campo. Esto lo hace más preciso cuando se dispone de series históricas suficientemente largas, pero también lo limita a estaciones donde existe registro de aforo.

Los casos de uso más frecuentes son:

- Dimensionamiento de estructuras de control (vertederos, compuertas)

- Diseño de protecciones ribereñas y defensas costeras

- Estimación de crecidas de diseño en puentes y alcantarillas

- Calibración de modelos lluvia-escorrentía cuando se dispone de aforos

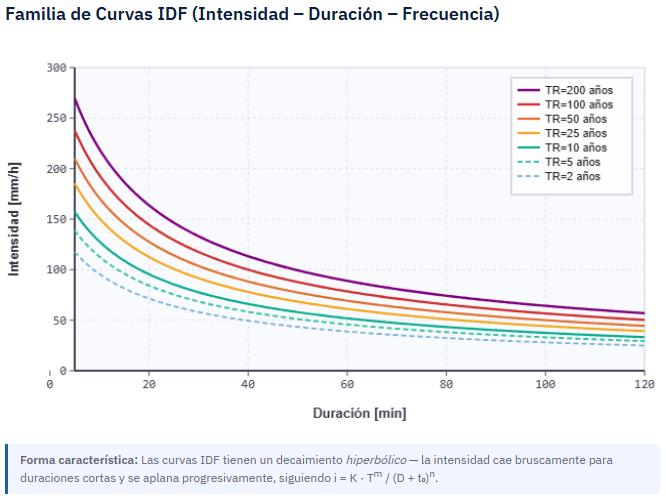

- Construcción de curvas IDF (que son en definitiva un análisis de frecuencias aplicado a registros pluviográficos)

1.1. ¿Qué datos necesitás?

La entrada del análisis es una serie de máximos anuales: el caudal (o parámetro que se esté analizando) máximo instantáneo registrado en cada año hidrológico de la estación de aforo. Lo recomendado es contar con al menos 15–20 años de registro para que el ajuste tenga representatividad estadística. Con menos de 10 años, los resultados deben tomarse con mucha precaución.

Existe también la serie de excedencias parciales (Peaks Over Threshold, POT), que incluye todos los eventos por encima de un umbral, no solo el máximo de cada año. Es más eficiente cuando la serie es corta, pero su análisis es más complejo. En esta entrada trabajamos con máximos anuales, que es la aproximación más usada en la práctica.

2. Conceptos estadísticos base

Antes de ajustar cualquier distribución, es fundamental tener claros tres conceptos que van a aparecer a lo largo de todo el análisis.

2.1. Período de retorno o recurrencia de diseño

El período de retorno T es el intervalo de tiempo promedio, expresado en años, dentro del cual se espera que un evento de magnitud x sea igualado o superado al menos una vez. No indica que el evento ocurra exactamente cada T años —es el valor promedio de un proceso aleatorio, y como tal, un mismo evento puede repetirse dos años seguidos o no ocurrir en un siglo.

La relación entre el período de retorno y la probabilidad de excedencia anual es:

P(X ≥ x) = 1 / T

Un caudal con T = 100 años tiene una probabilidad del 1% de ser superado en cualquier año dado.

2.2. Riesgo hidrológico

El riesgo R es la probabilidad de que el evento de diseño sea superado al menos una vez durante la vida útil de la obra, de n años:

R = 1 − (1 − 1/T)ⁿ

Por ejemplo, una alcantarilla diseñada para T = 25 años, con vida útil de 50 años, tiene un riesgo de:

R = 1 − (1 − 1/25)⁵⁰ = 1 − 0,96⁵⁰ ≈ 87%

Ese número suele sorprender: la probabilidad de que la obra sea superada al menos una vez en su vida útil es altísima, aun con períodos de retorno que suenan «grandes». Por eso, elegir el período de retorno de diseño es siempre una decisión que involucra consecuencias y nivel de riesgo aceptable, no solo matemática.

2.3. Posición de graficación

Cuando ordenas los datos de mayor a menor, a cada valor le asignas un rango m (m = 1 para el máximo) y una probabilidad de excedencia empírica mediante una fórmula de posición de graficación. La más usada en hidrología es la de Weibull:

P(X ≥ xₘ) = m / (n + 1)

Otras fórmulas comunes son Hazen y Blom. La diferencia entre ellas es pequeña con series largas, pero puede ser relevante en los extremos con series cortas.

3. Distribuciones estadísticas más usadas en hidrología

No todas las distribuciones funcionan igual para datos hidrológicos. Los caudales máximos suelen tener distribuciones asimétricas positivas —cola larga hacia la derecha— lo que descarta de entrada la distribución Normal estándar para la modelación de valores extremos.

3.1. Gumbel (GEV Tipo I)

La distribución de Gumbel es probablemente la más usada en hidrología para caudales y precipitaciones máximas. Pertenece a la familia de Valores Extremos Generalizados (Generalized Extreme Value, GEV) con parámetro de forma ξ = 0, y tiene la propiedad de ser la distribución límite de los máximos de muestras grandes de variables con distribución de cola liviana (exponencial).

Su función de distribución acumulada es:

F(x) = exp(−exp(−(x − u) / α))

donde u es el parámetro de posición (moda de la distribución) y α es el parámetro de escala. Por el método de momentos, los parámetros se estiman como:

α = (√6 · σ) / π ≈ 0,7797 · σ

u = x̄ − 0,5772 · α

El cuantil asociado a un período de retorno T es:

x_T = u + α · [−ln(−ln(1 − 1/T))]

La distribución de Gumbel está recomendada en numerosas normativas latinoamericanas y europeas, y es la que más frecuentemente se utiliza como primera aproximación en estudios regionales.

3.2. Log-Normal de dos parámetros

La distribución Log-Normal establece que el logaritmo natural de los datos sigue una distribución Normal. Es simple de aplicar: tomás logaritmos de la serie, calculás la media μ_Y y el desvío σ_Y de la serie transformada, y usás los cuantiles de la Normal estándar:

x_T = exp(μ_Y + z_T · σ_Y)

donde z_T es el cuantil de la distribución Normal estándar para la probabilidad F = 1 − 1/T. Es adecuada cuando los datos transformados pasan los tests de normalidad.

3.3. Log-Pearson III

La distribución Log-Pearson III es la distribución oficial del Bulletin 17C del USGS para análisis de frecuencias de crecidas en Estados Unidos, y es ampliamente adoptada a nivel global. Trabaja con los logaritmos de la serie, modelados mediante una distribución Pearson tipo III (gamma generalizada de tres parámetros).

Requiere estimar media, desvío estándar y coeficiente de asimetría (skewness) de los logaritmos. El cuantil se calcula como:

log(x_T) = ȳ + K_T(g) · s_Y

donde K_T(g) es el factor de frecuencia que depende del período de retorno y del coeficiente de asimetría g, obtenido de tablas del Bulletin 17C.

Su ventaja es que captura mejor la asimetría de la distribución, pero requiere series largas para estimar el coeficiente de asimetría con precisión. Con n < 25 años ese parámetro tiene alta incertidumbre.

3.4. ¿Cuál usar?

No existe una respuesta única. Lo más robusto es ajustar las tres distribuciones, aplicar un test de bondad de ajuste y seleccionar la que mejor represente los datos. Como orientación práctica:

- Gumbel como primera aproximación, especialmente con series de longitud moderada

- Log-Pearson III cuando se busca mayor rigor y la serie es larga (n ≥ 30)

- Log-Normal cuando los datos transformados muestran buena simetría

4. Ajuste por el método de momentos: ejemplo numérico con Gumbel

Trabajamos con una serie de 25 años de caudales máximos anuales de una estación hidrométrica (m³/s):

45 — 78 — 32 — 120 — 89 — 55 — 67 — 143 — 38 — 95 — 110 — 72 — 48 — 88 — 134 — 61 — 52 — 99 — 84 — 115 — 41 — 76 — 103 — 58 — 127

Paso 1: Estadísticos de la muestra

x̄ = 81,2 m³/s

σ = 31,9 m³/s (desvío estándar muestral, con n−1 en el denominador)

Paso 2: Parámetros de Gumbel

α = 0,7797 × 31,9 = 24,87

u = 81,2 − 0,5772 × 24,87 = 66,84 m³/s

Paso 3: Cuantiles de diseño

Para cada período de retorno T aplicamos la ecuación de cuantil de Gumbel:

x_T = 66,84 + 24,87 × [−ln(−ln(1 − 1/T))]

Paso 4: Posición de graficación de los datos observados

Ordenamos los 25 datos de mayor a menor y aplicamos Weibull: P_exc = m/(n+1) = m/26. Esto nos da las probabilidades empíricas de cada dato para superponer sobre el gráfico de la distribución ajustada.

5. Test de bondad de ajuste

Una vez ajustada la distribución, hay que verificar si el ajuste es estadísticamente aceptable. Los dos tests más usados en hidrología son:

5.1. Kolmogorov-Smirnov (KS)

Compara la máxima diferencia absoluta entre la distribución empírica F_emp(x) y la distribución teórica ajustada F_teo(x):

D = max | F_emp(xᵢ) − F_teo(xᵢ) |

Si D es menor al valor crítico D_α para el nivel de significancia elegido (generalmente α = 5%) y el tamaño muestral n, no se rechaza la hipótesis de que los datos provienen de la distribución ajustada.

El test de KS es no paramétrico, se aplica a la distribución completa y es el más usado para variables continuas en hidrología.

5.2. Chi-cuadrado (χ²)

Agrupa los datos en k clases y compara las frecuencias observadas Oᵢ con las esperadas según la distribución teórica Eᵢ:

χ² = Σ (Oᵢ − Eᵢ)² / Eᵢ

Si χ² calculado es menor al valor crítico χ²(k−p−1, α) —donde p es el número de parámetros estimados— no se rechaza la distribución. Requiere que cada clase tenga al menos 5 observaciones esperadas, lo que puede ser difícil con series cortas (n < 30).

5.3. Interpretación correcta

Es importante entender que ningún test estadístico «prueba» que los datos siguen una distribución. Solo indica si la evidencia disponible es suficiente para rechazarla o no. Con series hidrológicas típicas de 20–30 años, la potencia de los tests es baja, y varias distribuciones pueden pasar el test simultáneamente. En esos casos, la decisión debe basarse en la calidad del ajuste visual en la cola superior, el comportamiento físico esperado y el contexto regional.

6. Gráfico de papel de probabilidad

El gráfico de papel de probabilidad es la herramienta visual central del análisis de frecuencias. En él se representan:

- Los datos observados con sus probabilidades de excedencia empíricas (eje horizontal, escala especial) y sus caudales (eje vertical)

- La curva de la distribución ajustada, calculada a partir de los cuantiles teóricos

En el papel de probabilidad de Gumbel, el eje horizontal se escala en términos de la variable reducida y = −ln(−ln(F)), de manera que los datos de una distribución Gumbel perfecta se alinean en una recta. Esta es una propiedad clave: si los puntos observados siguen aproximadamente una recta en ese papel, la distribución de Gumbel es una representación adecuada.

El gráfico permite:

- Verificar visualmente la calidad del ajuste: ¿los puntos siguen la curva o la recta?

- Identificar outliers: puntos muy alejados de la tendencia general que merecen revisión

- Leer gráficamente los cuantiles para cualquier período de retorno

- Comparar distribuciones dibujando más de una curva ajustada sobre los mismos datos

Un buen ajuste muestra los puntos distribuidos aleatoriamente a ambos lados de la curva, sin tendencia sistemática. Si los puntos en la cola superior (los eventos más grandes) están todos por encima de la línea ajustada, la distribución subestima los caudales extremos —que es el escenario más peligroso en diseño hidráulico.

7. Los cuantiles de diseño y su incertidumbre

Los cuantiles estimados —como los de la tabla del Paso 3— son el insumo directo para el diseño hidráulico. Dependiendo del tipo de obra y la normativa aplicable, se elige el período de retorno de diseño:

- Alcantarillas viales menores: T = 10 a 25 años

- Puentes en caminos secundarios: T = 50 a 100 años

- Puentes en rutas nacionales: T = 100 a 200 años

- Presas y vertederos de seguridad: T = 1.000 a 10.000 años, o bien la PMF (Probable Maximum Flood)

- Redes de drenaje urbano: T = 2 a 10 años para red primaria, T = 25 a 100 años para canales maestros

Estos valores son orientativos; cada normativa nacional o provincial puede establecer criterios distintos, y cada profesional puede optar por un valor de seguridad que considere apropiado según su criterio.

Una consideración crítica: los cuantiles de baja probabilidad (T > 100 años) tienen alta incertidumbre cuando la serie es corta. Con n = 25 años, estimar el caudal de T = 500 años implica extrapolar muy lejos del rango de datos observados. Esa extrapolación depende fuertemente de qué distribución se eligió y debe acompañarse siempre de un análisis de sensibilidad o, como mínimo, de total transparencia sobre los supuestos adoptados.

8. Conclusiones

El análisis de frecuencias es una herramienta fundamental en hidrología aplicada cuando dispones de datos de aforo. El proceso completo incluye:

- Construir la serie de máximos anuales a partir de registros de aforo confiables

- Calcular los estadísticos de la muestra (media, desvío, coeficiente de asimetría)

- Estimar los parámetros de la distribución por el método de momentos o por máxima verosimilitud

- Aplicar un test de bondad de ajuste (KS o χ²) para verificar la adecuación estadística

- Construir el gráfico de papel de probabilidad para verificar el ajuste visualmente

- Leer los cuantiles de diseño para los períodos de retorno requeridos por la normativa

Cuando no disponés de datos de aforo —que es el caso más común en la práctica donde las redes hidrológicas son escasas— el camino es la hidrología indirecta: curvas IDF + Método Racional o CN + hidrogramas sintéticos.